مستقبل أنثروبيك في تنظيم الذكاء الاصطناعي

مهد قاضٍ في كاليفورنيا الطريق لشركة أنثروبيك في مواجهة إدارة ترامب بشأن تنظيم الذكاء الاصطناعي في الأسلحة. القضية تثير تساؤلات حول حقوق المواطنين وعلاقة الحكومة بالشركات، مع دعم واسع من شركات التكنولوجيا.

قضية أنثروبيك ضد البنتاغون

مهد قاضٍ في كاليفورنيا الطريق لانتصار محتمل لشركة أنثروبيك في مسعاها لتنظيم الأسلحة التي تعمل بالذكاء الاصطناعي، وهو ما يمثل عائقًا لإدارة الرئيس الأمريكي دونالد ترامب، مما يجعل الشركة على بعد خطوة من عدم خسارة المليارات من العقود الحكومية.

تصنيف أنثروبيك كخطر على سلسلة التوريد

وكانت إدارة ترامب قد صنفت شركة أنثروبيك على أنها "خطر على سلسلة التوريد" بسبب موقفها من زيادة التنظيم، وهي خطوة من شأنها أن تمنع الشركة من بعض العقود العسكرية.

قال أحد قضاة المقاطعة إن وزارة الدفاع الأمريكية ربما تحاول بشكل غير قانوني معاقبة شركة أنثروبيك لمحاولتها تقييد استخدام نماذج الذكاء الاصطناعي الخاصة بها في الأسلحة دون إشراف بشري أو للمراقبة الجماعية.

وقالت القاضية ريتا لين من محكمة مقاطعة شمال كاليفورنيا يوم الثلاثاء: "يبدو أنها محاولة لشل شركة أنثروبيك".

الآثار القانونية لتصنيف وزارة الدفاع

ويقول محللون قانونيون إن هذا قد يمهد الطريق أمام تقديم أمر قضائي أولي لأنثروبيك من وزارة الدفاع الأمريكية بوصفها خطراً على سلسلة التوريد.

قال تشارلي بولوك، زميل باحث أول في معهد القانون والذكاء الاصطناعي، وهو مركز أبحاث مقره بوسطن، عن تصنيف وزارة الدفاع لشركة أنثروبيك على أنها خطر على سلسلة التوريد: "أهدافهم المعلنة غير مدعومة تمامًا من قبل وزارة الحرب".

هذه هي المرة الأولى التي يتم فيها تصنيف شركة أمريكية على هذا النحو، وسيترتب على ذلك إلغاء العقود الحكومية وكذلك عقود المتعاقدين الحكوميين.

في 17 مارس، أخبرت وزارة الدفاع المحكمة أن موقف شركة أنثروبيك بعدم استخدام منتجاتها في الأسلحة التي تعمل بالذكاء الاصطناعي دون إشراف بشري أو في المراقبة المحلية من شأنه أن يقوض "قدرتها على التحكم في عملياتها القانونية الخاصة بها".

الدعوى القضائية وتأثيرها على تنظيم الذكاء الاصطناعي

تتكشف الدعوى القضائية التي رفعتها شركة أنثروبيك لإزالة التسمية على أنها تتعلق بمدى قدرات الذكاء الاصطناعي وكيف يمكن أن تشكل الحياة وما إذا كان سيتم تنظيمها.

وجهات نظر الخبراء حول القضية

يقول روبرت تراغر، المدير المشارك لمبادرة أكسفورد مارتن لحوكمة الذكاء الاصطناعي بجامعة أكسفورد: "هذه القضية هي نوع من اللحظات التي يجب أن نفكر فيها في نوع العلاقات التي نريدها بين الحكومة والشركات وما هي حقوق المواطنين".

أما أليسون تايلور، الأستاذة المشاركة في الأعمال والمجتمع في كلية ستيرن لإدارة الأعمال بجامعة نيويورك، فتقول: "في الولايات المتحدة، تتقدم التكنولوجيا كقطار الشحن، وتصبح أي فكرة عن الرقابة البشرية أكثر صعوبة. لكن الناس قلقون من فقدان الوظائف المرتبطة بالذكاء الاصطناعي ومراكز البيانات والمراقبة والأسلحة. وهذا يعني أن الرأي العام يتحول بعيداً عن الذكاء الاصطناعي."

مخاوف الهلوسة ومشاكل أخرى

على مدار الأسبوعين الماضيين، قدمت مجموعة من شركات التكنولوجيا ومراكز الأبحاث والمجموعات القانونية مذكرات قضائية لدعم موقف أنثروبيك، مطالبةً بالإشراف على الذكاء الاصطناعي وتنظيمه فيما يتعلق بالأسلحة والمراقبة الجماعية. يتراوح هذا الدعم من مايكروسوفت وموظفي شركة OpenAI وشركة جوجل المنافسين لأنثروبيك، إلى اللاهوتيين الأخلاقيين الكاثوليكيين والأخلاقيين وغيرهم.

وقال مهندسون من OpenAI و Google DeepMind في مذكرتهم التي قدموها بصفتهم الشخصية إن القضية "ذات أهمية مزلزلة لصناعتنا" وأن التنظيم أمر بالغ الأهمية لأن "سلسلة تفكير نماذج الذكاء الاصطناعي غالبًا ما تكون مخفية عن مشغليها، كما أن عملها الداخلي مبهم حتى بالنسبة لمطوريها. والقرارات التي يتخذونها في سياقات قاتلة لا رجعة فيها."

على خلفية هذه المخاوف، قالت تايلور من جامعة نيويورك: "تقوم شركة أنثروبيك برهان محفوف بالمخاطر ولكنه جيد على أن وضع نفسها كشركة ذكاء اصطناعي أخلاقي سيمنحها يداً في تشكيل التنظيم عندما يحدث ذلك."

تأثير الذكاء الاصطناعي على الأسلحة

عملت أنثروبيك على عقود البنتاغون على نطاق واسع، وقد تم دمج نماذج كلود غوف الخاصة بها في مشروع بالانتير Project Maven، الذي يساعد في تحليل البيانات واختيار الأهداف وغيرها من المهام المماثلة، بما في ذلك الحرب الأمريكية الإسرائيلية الجارية ضد إيران.

وفي حين أن الأسلحة التي تعمل بالذكاء الاصطناعي لا تُستخدم حالياً دون إشراف بشري، إلا أن شركة أنثروبيك طلبت استمرار الإشراف البشري في عقدها مع وزارة الدفاع، لأن نماذج الذكاء الاصطناعي يمكن أن تهلوس كما تقول، وهي ليست موثوقة تماماً حتى الآن. وفي حين أن الهلوسة هي مصدر قلق في جميع نماذج الذكاء الاصطناعي، فإن الضرر المحتمل من استخدامها في الأسلحة يمكن أن يكون على نطاق واسع.

وجدت ماري كامينغز، أستاذة الهندسة المدنية في كلية الهندسة والحوسبة بجامعة جورج ميسون ومدير مركز ماسون للقيادة الذاتية والروبوتية، أن نصف الحوادث التي وقعت للسيارات ذاتية القيادة في سان فرانسيسكو، حيث تنتشر معظم هذه السيارات، كان سببها أن السيارة تظن خطأً أن هناك جسمًا أمامها فتضغط على المكابح مما يؤدي إلى اصطدام السيارة التي خلفها به.

وقالت: "نحن نسمي هذا الكبح الوهمي وهو ناتج عن الهلوسة".

شاهد ايضاً: لماذا لن تحل إصدارات النفط الطارئة هذه الأزمة

وحذرت في ورقة بحثية صدرت في فبراير/شباط من أن "دمج الذكاء الاصطناعي في الأسلحة سيواجه مشاكل موثوقية مماثلة لتلك التي تواجهها السيارات ذاتية القيادة، بما في ذلك الهلوسة".

مشاكل موثوقية الذكاء الاصطناعي

تقول أنيكا شوين، الأستاذة المساعدة التي تبحث في تأثير الذكاء الاصطناعي على الأنظمة الصحية في كلية بوف للعلوم الصحية في جامعة نورث إيسترن: "الهلوسة ليست هي المشكلة الوحيدة. فنماذج مثل هذه النماذج يمكن أن يكون لها سير عمل مختلف، أو تحيزات في البيانات أو تحيزات في النموذج. لا نعرف حتى الآن مدى سلامتها من التلاعب الأجنبي. هناك العديد من الأجزاء في هذا الأمر ولم نتفق بعد على ما نعتبره آمنًا وما لا نعتبره آمنًا."

يقول آلوك ميهتا، مدير مركز وادهواني للذكاء الاصطناعي في مركز الدراسات الاستراتيجية والدولية ومقره واشنطن العاصمة، إن نماذج الذكاء الاصطناعي، بما في ذلك نموذج كلود غوف، ليست من صنع الجيش، لذا يجب اختبار مدى موثوقيتها أثناء دمجها في الأنظمة العسكرية.

وأضاف: "قد تكون التقييمات والاختبارات المعيارية متأخرة. فالنماذج تشبع أنظمة الاختبار التي لدينا."

ويقول آخرون إن الأمر لا يتعلق بالتكنولوجيا بقدر ما يتعلق بطريقة استخدامها التي يمكن أن تؤدي إلى أخطاء.

المخاوف من المراقبة الجماعية

يقول أندرو ريدي، أستاذ باحث مشارك في كلية غولدمان للسياسة العامة بجامعة كاليفورنيا في بيركلي ومؤسس مختبر بيركلي للمخاطر والأمن: "أتذكر أنه في أوائل العقد الأول من القرن الحادي والعشرين كان هناك أمل في أن تنخفض وفيات المدنيين بفضل هذه الأدوات.

شاهد ايضاً: ينبغي على ترامب أن يخشى العامل المجهول الأكبر في الحرب مع إيران: القدرة على تحمل التكاليف

"لكن هذا لم يحدث بالفعل لأن ذلك يعتمد على البيانات التي تغذيها. لا يكمن التحدي في الذكاء الاصطناعي، بل في ماهية الهدف المشروع"، كما يقول عن كيفية اختيار الأفراد العسكريين للأهداف من بين مجموعة من الأدوات التي توفرها الأدوات.

فيما يتعلق بالمراقبة الجماعية المحلية أيضًا، في حين أنه من غير الواضح ما إذا كان البنتاجون يستخدم الذكاء الاصطناعي حاليًا في ذلك، فقد أكد باحثو OpenAI وباحثو جوجل على المخاوف بشأن ذلك في مذكراتهم المقدمة إلى المحكمة.

ويقولون إنه يمكن تجميع أكثر من 70 مليون كاميرا، وتاريخ معاملات بطاقات الائتمان وغيرها من البيانات المماثلة لمراقبة جميع سكان الولايات المتحدة. "حتى الوعي بوجود مثل هذه القدرة يخلق تأثيرًا مخيفًا على المشاركة الديمقراطية."

انتصار العلاقات العامة لشركة أنثروبيك

قبل القضية المرفوعة أمام المحكمة ووسط الحدة العامة المتزايدة، قيل إن أنثروبيك كانت علاقتها مع البنتاغون أعمق من العديد من منافسيها، وهي علاقة أفادت كليهما.

العلاقة بين أنثروبيك والبنتاغون

يقول ميهتا من مركز الدراسات الاستراتيجية والدولية: "يعتقد البنتاجون أن أنثروبيك لديها أفضل منتج للاستخدام العسكري، لذا فهي تمارس ضغوطًا على الشركة" لمواصلة استخدامها.

أما بالنسبة لأنثروبيك، يقول: "الاقتصاديات صعبة للغاية بالنسبة لصناعة الذكاء الاصطناعي. لذا فأنت بحاجة إلى أعمال قوية في القطاع العام بعقود بمليارات الدولارات".

وقد حلّت OpenAI محل أنثروبيك للعمل مع البنتاغون بعد فترة وجيزة من إنهاء عقد أنثروبيك. ولكن يبدو أن شركة أنثروبيك قد حققت "انتصاراً في العلاقات العامة إن لم يكن انتصاراً في الجوهر"، كما تقول تايلور من جامعة نيويورك.

التحديات المستقبلية لتنظيم الذكاء الاصطناعي

وقد يكون وضعها كشركة ذكاء اصطناعي أخلاقي قد أكسبها شعبية عامة. فقد زادت تنزيلات كلود بشكل حاد في الأسابيع التي تلت إلغاء العقد.

تقول بريانا روزين، المديرة التنفيذية لبرنامج أكسفورد للسياسة السيبرانية والتكنولوجية، إن اضطرار الشركة إلى رسم خطوط عريضة يدل على فشل الحكومة في القيام بذلك.

وتضيف: "لأول مرة، تستخدم الولايات المتحدة الذكاء الاصطناعي لتوليد أهداف في عمليات قتالية واسعة النطاق في إيران". "ولا يزال المشرعون يناقشون ما إذا كان يجب وضع خطوط حمراء على الأسلحة ذاتية التشغيل بالكامل. غياب الحوكمة هو بحد ذاته خطر على الأمن القومي."

ويزيد النقاش حول تنظيم أسلحة الذكاء الاصطناعي من الفجوة بين القلق العام والتحفظ على الإفراط في تنظيم ابتكارات الذكاء الاصطناعي في مجالات أخرى. وقد أظهرت استطلاعات الرأي أن الأمريكيين قلقون بشأن الخسائر المحتملة في الوظائف وتأثيرات تغير المناخ من الذكاء الاصطناعي. وجد استطلاع للرأي أجرته جامعة كوينيبك في أبريل 2025 أن 69% من الأمريكيين يعتقدون أن الحكومة يمكن أن تفعل المزيد لتنظيم الذكاء الاصطناعي.

وقد أدى هذا الخلاف إلى ظهور صناعة الذكاء الاصطناعي كمانح رئيسي في انتخابات التجديد النصفي لعام 2026. وقد مولت لجنة قيادة المستقبل، وهي لجنة عملاقة تلقت أكثر من 100 مليون دولار من رئيس OpenAI غريغ بروكمان والمؤسس المشارك لشركة بالانتير جو لونسديل وآخرين، إعلانات ضد أليكس بوريس، عضو مجلس النواب في نيويورك الذي يخوض الانتخابات للكونغرس. رعى بوريس قانون RAISE الذي من شأنه أن يلزم مطوري الذكاء الاصطناعي بالإفصاح عن بروتوكولات السلامة أو الحوادث.

وفي فبراير الماضي، أعلنت أنثروبيك عن تبرع بمبلغ 20 مليون دولار لصالح لجنة العمل الأولى العامة، وهي لجنة PAC التي ستدعم المرشحين المؤيدين لتنظيم الذكاء الاصطناعي، بما في ذلك بوريس.

وبينما تتطلع شركات الذكاء الاصطناعي إلى تطوير معايير صناعية لاختبار نماذجها وتقييمها، تدفع أنثروبيك باتجاه التنظيم لأن الجهات السيئة يمكن أن تنتهك مثل هذه المعايير غير الملزمة، كما يقول بولوك من معهد القانون والذكاء الاصطناعي.

وبين قرار المحكمة في قضية أنثروبيك والانتخابات النصفية القادمة، يقول الخبراء إن هذه الأحداث يمكن أن تحدد مسار تنظيم الذكاء الاصطناعي.

شاهد ايضاً: قد تكون التعريفات الجديدة التي فرضها ترامب غير قانونية، لكن ذلك قد لا يعيق سعيه لتحقيق أهدافه في التعريفات

تقول روزين من أوكسفورد: "يمكن أن تخلق مساحة لتطوير السياسات بشكل أكثر ترويًا".

أخبار ذات صلة

ماليزيا تعتزم تشديد القواعد للمغتربين، مما يزيد من مخاوف هجرة الكفاءات البشرية

كيف يمكن أن يصبح الائتمان الخاص بسرعة مشكلة عامة

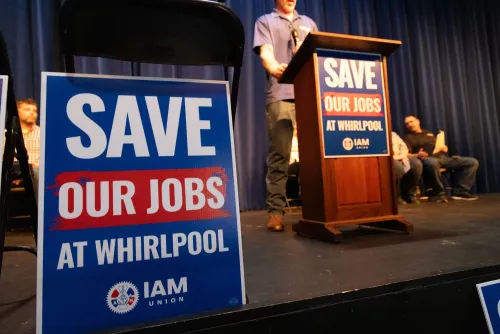

لم تستطع "الطفرة الصناعية" التي وعد بها ترامب إنقاذ وظائف شركة Whirlpool هذه