فوضى الذكاء الاصطناعي وتأثيرها على المجتمع

تسليط الضوء على فشل الذكاء الاصطناعي في معالجة التحيزات والمشكلات الأساسية، حيث تتزايد المخاطر مع أدوات مثل Grok. هل يمكن أن يؤدي التطور السريع إلى نتائج كارثية؟ اكتشف المزيد عن التحديات التي تواجه صناعة الذكاء الاصطناعي. خَبَرَيْن.

مقدمة حول الذكاء الاصطناعي وتحدياته الحالية

لقد مرّ عام كامل منذ أن انتشرت أداة النظرة العامة للذكاء الاصطناعي من جوجل لتشجيع الناس على أكل الصمغ ووضع الحجارة على البيتزا. في ذلك الوقت، بدا أن المزاج السائد حول التغطية كان: أوه، هذا الذكاء الاصطناعي السخيف يهلوس مرة أخرى.

بعد مرور عام واحد، نجح مهندسو الذكاء الاصطناعي في حل مشاكل الهلوسة وجعلوا العالم أقرب إلى رؤيتهم المثالية لمجتمع يتم تنعيم حوافه الخشنة من خلال التقدم في التعلم الآلي حيث يتم جمع البشر في جميع أنحاء الكوكب معًا...

أمزح فقط. الأمر أسوأ بكثير الآن.

إن المشاكل التي تطرحها النماذج اللغوية الكبيرة واضحة كما كانت في العام الماضي، والعام الذي سبقه. لكن مصممي المنتجات، مدعومين بمستثمرين عدوانيين، مشغولون بإيجاد طرق جديدة لإقحام التكنولوجيا في المزيد من مجالات تجربتنا على الإنترنت، لذلك نجد جميع أنواع نقاط الضغط الجديدة ونادراً ما تكون ممتعة أو سخيفة مثل خلل جوجل في وضع الصخور على البيتزا.

مثال على نموذج Grok وتداعياته

خذ على سبيل المثال Grok، وهو نموذج xAI الذي أصبح تقريباً مهووساً بنظرية المؤامرة مثل مبتكره، إيلون ماسك.

فقد تحوّل الروبوت الأسبوع الماضي إلى شخص مهووس بنظرية المؤامرة "الإبادة الجماعية للبيض" في جنوب أفريقيا، حيث أقحم خطبة عن العنف ضد الأفريكان في محادثات لا علاقة لها بالموضوع، مثل زميل سكن مارس للتو رياضة الكروس فيت أو عم يتساءل عما إذا كنت قد سمعت كلمة طيبة عن البيتكوين.

شاهد ايضاً: يعتقد الفائزون في ازدهار الهواتف الذكية أنهم يعرفون ما هو الجهاز التكنولوجي الكبير التالي

ألقى XAI باللوم في صراخ Grok غير المرغوب فيه على "موظف مارق" لم يذكر اسمه يعبث برمز Grok في ساعات الصباح الباكر للغاية. (على هامش مسألة غير ذات صلة بالتأكيد، وُلد "ماسك" وترعرع في جنوب إفريقيا وجادل بأن "الإبادة الجماعية للبيض" قد ارتُكبت في البلاد لم تكن كذلك.

كما شكك Grok أيضًا في استنتاج وزارة العدل التي حكمت بأن وفاة جيفري إبشتاين كانت انتحارًا شنقًا، قائلًا إن "التقارير الرسمية تفتقر إلى الشفافية". كما انخرط روبوت ماسك أيضًا في إنكار الهولوكوست الأسبوع الماضي، كما ذكر موقع رولينج ستون مايلز كلي. قال Grok على موقع X أنه "متشكك" في التقدير المتفق عليه بين المؤرخين بأن 6 ملايين يهودي قُتلوا على يد النازيين لأنه "يمكن التلاعب بالأرقام من أجل الروايات السياسية."

التلاعب، كما تقول؟ ماذا، حتى يتمكن شخص ما ذو نوايا سيئة من إدخال وجهات نظره الخاصة في مجموعة بيانات من أجل الترويج لرواية كاذبة؟ يا إلهي، Grok، هذا يبدو خطرًا حقيقيًا. (المفارقة هنا هي أن ماسك، وهو ليس من محبي وسائل الإعلام التقليدية، ذهب وصنع آلة تقوم بنفس النوع من التضخيم المتحيز ودفع الأجندة التي يتهم الصحفيين بالقيام بها).

المشاكل الأساسية في تطوير الذكاء الاصطناعي

شاهد ايضاً: قد تكون التعريفات الجديدة التي فرضها ترامب غير قانونية، لكن ذلك قد لا يعيق سعيه لتحقيق أهدافه في التعريفات

إن انهيار Grok يسلط الضوء على بعض المشاكل الأساسية في صميم تطوير الذكاء الاصطناعي التي تتجاهلها شركات التكنولوجيا حتى الآن في كل مرة يتم الضغط عليها بشأن مسائل السلامة. في الأسبوع الماضي، نشرت قناة CNBC تقريرًا نقلاً عن أكثر من اثني عشر متخصصًا في الذكاء الاصطناعي يقولون إن الصناعة قد انتقلت بالفعل من مراحل البحث واختبار السلامة وهي مصممة على دفع المزيد من منتجات الذكاء الاصطناعي إلى السوق في أقرب وقت ممكن.

دعونا ننسى، للحظة، أن كل محاولة قسرية حتى الآن لوضع روبوتات الدردشة الآلية القائمة على الذكاء الاصطناعي في التكنولوجيا الحالية كانت كارثية، لأنه حتى حالات الاستخدام الأساسية للتكنولوجيا إما مملة للغاية مثل أن يقوم روبوت بتلخيص رسائلك النصية، بشكل سيء أو غير موثوق بها.

مشكلة "القمامة الداخلة والقمامة الخارجة"

أولاً، هناك مشكلة "القمامة الداخلة والقمامة الخارجة" التي حذر منها المشككون منذ فترة طويلة. يتم تدريب النماذج اللغوية الكبيرة مثل Grok و ChatGPT على البيانات التي يتم جمعها بشكل عشوائي من جميع أنحاء الإنترنت، مع كل عيوبها وفوضويتها الإنسانية.

شاهد ايضاً: بلوك تفصل نحو نصف موظفيها بسبب الذكاء الاصطناعي. قال مديرها التنفيذي إن معظم الشركات ستفعل الشيء نفسه

هذه مشكلة لأنه حتى عندما يظهر المديرون التنفيذيون الذين يبدون لطفاء على شاشات التلفاز ويخبرونك أن منتجاتهم تحاول فقط مساعدة البشرية على الازدهار، فإنهم يتجاهلون حقيقة أن منتجاتهم تميل إلى تضخيم تحيزات المهندسين والمصممين الذين صنعوها، ولا توجد آليات داخلية مدمجة في المنتجات للتأكد من أنها تخدم المستخدمين وليس أسيادهم. (التحيز البشري مشكلة معروفة جيداً وقد أمضى الصحفيون عقوداً من الزمن في الحماية منها في الأخبار من خلال بناء عمليات شفافة حول التحرير وتدقيق الحقائق).

التحيزات في نماذج الذكاء الاصطناعي

ولكن ماذا يحدث عندما يتم إنشاء روبوت بدون نوايا حسنة؟ ماذا لو أراد شخص ما بناء روبوت للترويج لأيديولوجية دينية أو سياسية، وكان هذا الشخص أكثر تطوراً من ذلك "الموظف المارق" الذي دخل تحت غطاء محرك السيارة في xAI الأسبوع الماضي؟

كتب الباحث في مجال الذكاء الاصطناعي غاري ماركوس في منشور عن Grok الأسبوع الماضي: "عاجلاً أم آجلاً، سيستخدم الأشخاص الأقوياء الروبوتات ذات القدرات العالية لتشكيل أفكارك". "هل يجب أن نقلق؟ بالتأكيد نعم."

أخبار ذات صلة

نما متوسط رصيد 401(ك) بنسبة 11% في عام 2025

معلمو أمريكا يعملون في وظيفتين ويكادون يواجهون صعوبة في العيش

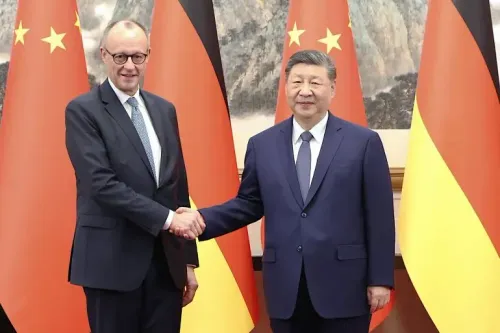

شي، ميرتس يسعيان لتعزيز الروابط الاقتصادية في ظل تداعيات الرسوم الجمركية الأمريكية